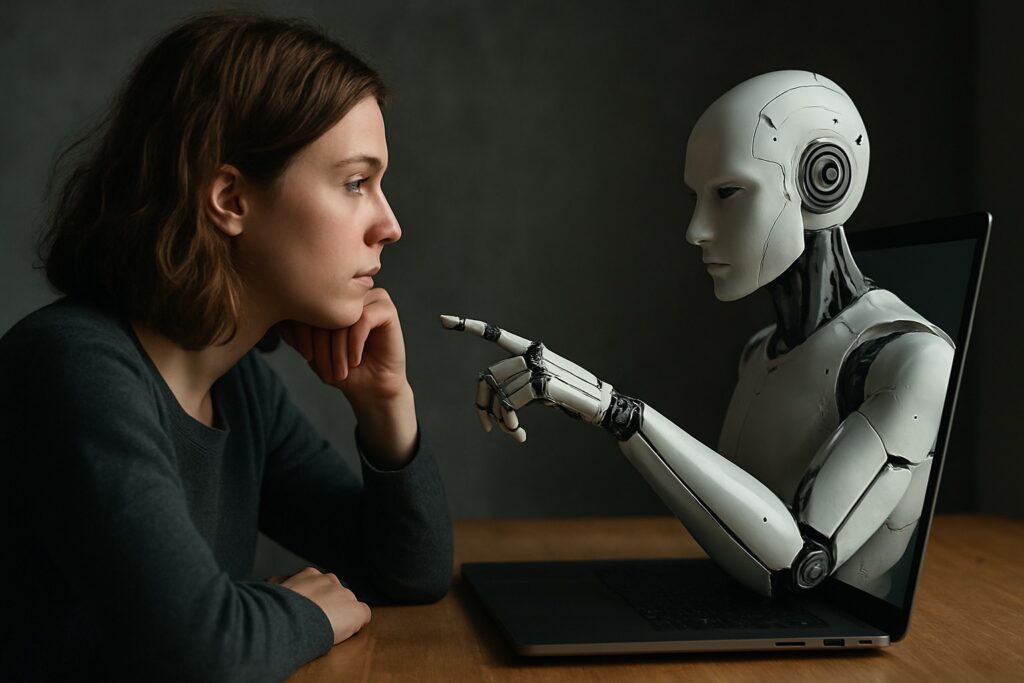

Hvordan påvirker det oss at KI kan forutsi hva vi tenker og føler – før vi selv gjør det? Et blikk på selvforståelse i en data-drevet tid.

Jeg vet ikke om du har merket det – men noen ganger virker det nesten som om algoritmene vet hva du føler, før du selv gjør det.

Du åpner telefonen.

Du scroller litt.

Og plutselig dukker det opp noe…

En video, en setning, et bilde – som treffer noe i deg.

Som får deg til å tenke: «Hvordan visste den det?»

Er det bare tilfeldigheter – eller kjenner maskinen oss bedre enn vi kjenner oss selv?

🎙️ Følelsen av å bli lyttet til – er det ekte?

Mange har opplevd det:

Du snakker med en venn om en reise, et produkt eller et tema – og kort tid etter dukker det opp reklame for nettopp det. Det føles som om mobilen lytter til deg.

Men stemmer det egentlig?

De fleste teknologiselskaper nekter for at de bruker mikrofonen din til målrettet reklame uten samtykke. Det som derimot er sant, er at algoritmer er ekstremt dyktige til å forutsi hva du kommer til å være interessert i – basert på alt fra søkehistorikk og nettadferd til hvem du omgås og hva du tidligere har reagert på.

Så kanskje mobilen ikke lytter aktivt til ordene dine – men den kjenner deg så godt at den vet hva du tenker på, nesten før du gjør det.

Det forklarer ikke alt – men det forklarer mer enn vi liker å tro.

🎧 Hva tror vi egentlig?

Men følelsen slipper ikke helt taket, gjør den vel? Selv om teknologiselskapene sier at de ikke lytter til oss – er det mange som ikke helt tror dem. Og det er kanskje ikke så rart.

For når mobilen nesten for godt gjetter hva vi tenker på, føles det ikke som tilfeldig sammenfall. Det føles personlig. Inngripende. Nesten litt magisk – eller ubehagelig.

Og sannheten? Den er både teknisk og psykologisk.

📱 Teknisk sett sier de fleste eksperter at det er lite sannsynlig at appene konstant lytter – det krever store ressurser, strøm og lagring. Men noen apper har tilgang til mikrofonen din – og selv om de «ikke bruker den aktivt», må vi nesten stole på at de lar være.

🧠 Psykologisk sett skjer det også noe interessant: Når vi blir gjort oppmerksom på et tema – gjennom en samtale – blir vi også mer sensitive for å legge merke til det rundt oss. Dette kalles bekreftelsesbias, og det gjør at vi plutselig ser reklamen vi kanskje har oversett før.

Men… det finnes også gråsoner.

TikTok har blitt forbudt i flere land – spesielt på offentlige enheter – blant annet fordi det er mistanke om at appen kan samle mer data enn den opplyser om. Og det handler ikke bare om lytting, men om hele pakken: lokasjon, tastemønster, ansiktsgjenkjenning og hvem du snakker med. Når data kobles sammen, kan systemet få en nesten uhyggelig god forståelse av hvem du er.

Så hva gjør vi?

Kanskje handler det ikke bare om om vi blir lyttet til.

Men om vi føler at vi ikke lenger har kontroll over hva som samles inn – og hvorfor.

For tillit bygges ikke bare på teknologi.

Den bygges på åpenhet, respekt og mulighet til å si nei.

Og akkurat det bør vi snakke mer om.

📊 Når data blir til innsikt

Kunstig intelligens lærer av oss – hele tiden.

Av det vi søker på, klikker på, stopper opp ved, kjøper, skriver, sier og deler.

Den vet når vi er slitne.

Den gjetter hva vi drømmer om.

Den foreslår tanker vi ikke visste vi trengte.

Og det er både praktisk – og litt foruroligende.

For hva skjer med vår egen selvforståelse, når maskinen kan kartlegge mønstrene våre så godt at den vet hva vi trenger, før vi selv gjør det?

🧠 Å vite – og å oppdage

Menneskelig bevissthet er langsom, kompleks og ofte uklar.

Vi bruker tid på å kjenne etter.

Vi skriver dagbok, går turer, fører samtaler – for å komme i kontakt med hva vi egentlig føler.

Men algoritmen trenger ikke den prosessen.

Den bruker milliarder av datapunkter og sammenligner deg med millioner av andre. Og plutselig treffer den noe – ikke fordi den forstår deg, men fordi den gjenkjenner deg.

Den vet kanskje hva du pleier å gjøre – men vet den hvorfor?

💬 Når vi outsourcer selvinnsikt

Vi begynner kanskje å stole mer på hva «den foreslår» enn på vår egen intuisjon. Hva vi bør kjøpe, spise, lese, føle, mene.

Og etter hvert: Hvem vi er.

Men menneskelig selvinnsikt er ikke en statistisk profil.

Den er noe vi erfarer over tid.

Gjennom motstand, stillhet, valg og feil.

Når vi lar algoritmene definere oss, risikerer vi å bli forutsigbare versjoner av oss selv. Og miste noe av det dypeste ved å være menneske:

Evnen til å overraske – til å forandre – til å velge annerledes.

🔍 Så hva er egentlig selvforståelse – i algoritmens tid?

Kanskje vi må lære oss å bruke innsikten algoritmene gir – uten å la den bli hele sannheten.

Kanskje den kan fungere som et speil – men ikke som en dommer.

For KI vet mye.

Men det vet ikke hvordan det er å være deg.

Det vet ikke hvordan det er å være menneske – og våkne en dag og føle noe helt nytt, bare fordi solen faller annerledes inn gjennom vinduet. Og det er kanskje der selvforståelsen bor – i det som ikke lar seg regne ut.

🌱 Til ettertanke:

- Har du noen gang kjent deg gjenkjent av en algoritme – og blitt litt skremt av det?

- Hvor går grensen mellom hjelp og påvirkning?

- Hva vil du fortsatt ha som din egen prosess – selv om KI kan forutsi hva du trenger?

- Og hva tror du at bare du kan vite om deg selv?

Selvforståelse kan ikke effektiviseres.

Den må leves. Kjenne. Erfares.

Og kanskje er det nettopp i det langsomme, tvilende og uperfekte – at vi virkelig finner ut hvem vi er.

– Anneli Brannfjell

Legg igjen en kommentar